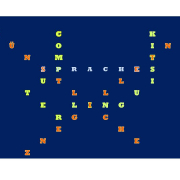

Wie künstlich intelligent ist Computerlinguistik?

Ein Beitrag aus unserer Reihe Künstliche Intelligenz zum Wissenschaftsjahr 2019 Angesichts der nahe liegenden Assoziation Computer + Sprache = Computerlinguistik könnte die Frage aufkommen, womit sich in Abgrenzung dazu die Künstliche Intelligenz (KI) befasst, wenn sie sich mit Sprache befasst. Beleuchten wir, wie im ersten Beitrag unserer Blogreihe angekündigt, das Verhältnis beider Disziplinen zueinander, und […]

Susanne Henschel

Susanne Henschel