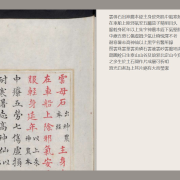

121 Million Chinese Characters Now Searchable in Our Digitized Collection: Full-Text Access Powered by OCR

Our collaboration with Academia Sinica (Taiwan) has recently reached a significant milestone. With generous support from the Center for Digital Cultures at the Academia Sinica, we are now able to provide full-text access to our digital Chinese collection. This includes 1,937 titles and over 121 million Chinese characters.