„Artificial Morality“ oder: Können und sollen Maschinen moralisch handeln?

Ein Beitrag aus unserer Reihe Künstliche Intelligenz zum Wissenschaftsjahr 2019

Vom Sprachassistenten über selbstfahrende Autos bis zum Pflege-Roboter oder Kampfdrohnen: Künstliche Intelligenz (oder kurz: KI) spielt mittlerweile in vielen Bereichen des Lebens eine wichtige Rolle.

Je komplexer und autonomer künstliche Systeme werden, desto mehr lösen sie sich vom Einfluss des Menschen. Maschinen regulieren ihr Verhalten in einem gewissen Rahmen selbst und werden zunehmend unabhängig von Menschen, die die Maschinen unmittelbar bedienen.

Doch je komplexer die Einsatzbereiche autonomer Systeme sind, desto anspruchsvoller werden auch die moralischen Entscheidungen, die die Maschinen treffen müssen. Eine permanente Überwachung und Kontrolle solcher Systeme durch einen Menschen, der die moralisch relevanten Entscheidungen trifft, wird in vielen Fällen kaum möglich sein.

In allen drei Bereichen – Pflegesysteme, Kriegsroboter und Fahrzeuge – stehen autonome Systeme vor grundlegenden moralischen Entscheidungen, in denen es manchmal sogar um Leben und Tod geht. Was ist, wenn ein autonomes Fahrzeug keine andere Wahl hat, als entweder eine alte Dame oder ein Kind zu töten? Was, wenn es nur dadurch, dass es eine auf dem Gehweg stehende Person anfährt, fünf Menschenleben retten kann? Ist ein besonderer Schutz für die Insassen moralisch legitim oder kommt den anderen Verkehrsteilnehmern vom moralischen Standpunkt her mehr Gewicht zu?

Kann man Maschinen solche Entscheidungen überlassen? Darf man es oder sollte man es gar? Können Maschinen überhaupt moralisch handeln, und sollen sie es? Wie konstruiert man eine moralische Maschine? Das sind die grundlegenden Fragen, denen Prof. Dr. Catrin Misselhorn in ihrem Buch Grundfragen der Maschinenethik nachgeht.

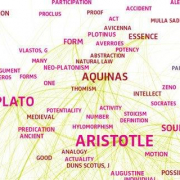

Maschinenethik ist ein neues Forschungsgebiet an der Schnittstelle von Informatik und Philosophie, das die Entwicklung moralisch agierender Maschinen zum Ziel hat. Gegenstand ist die Entwicklung einer Ethik für Maschinen im Unterschied zu einer Ethik für Menschen im Umgang mit Maschinen. Dieses Thema ist in der Geschichte der Ethik neu – erst mit der Entstehung hochentwickelter Computer wurde es relevant, ja sind Maschinen als moralische Akteure überhaupt in den Bereich des Möglichen gerückt. Es geht darum, auf der Grundlage von Computertechnologie Maschinen zu gestalten, die selbst moralische Entscheidungen treffen und umsetzen können.

Analog zu „Artificial Intelligence“ (AI) spricht man von „Artificial Morality“ (AM). Während AI zum Ziel hat, intelligentes Verhalten zu modellieren oder zu simulieren, geht es bei der AM darum, künstliche Systeme mit der Fähigkeit zu moralischem Entscheiden und Handeln auszustatten.

2015 haben namhafte KI-Forscher und Wissenschaftlerinnen einen offenen Brief verfasst, in dem sie die Maschinenethik als eines der wichtigsten und drängendsten Forschungsgebiete der KI hervorheben.

Literatur:

- „Maschinenethik und ‚Artificial Morality‘: Können und sollen Maschinen moralisch handeln?“ von Catrin Misselhorn in der Zeitschrift Aus Politik und Zeitgeschichte, die sich in der Ausgabe 6-7/2018 der Künstlichen Intelligenz, der Robotik und der Maschinenethik widmet. Hier findet sich auch der grundlegende Beitrag von Oliver Bendel „Überlegungen zur Disziplin der Maschinenethik“

- Moral machines: teaching robots right from wrong von Wendell Wallach und Colin Allen gilt neben Machine ethics (wird in Kürze im StaBiKat zu finden sein) von Michael Anderson und Susan Leigh Anderson als maßgebliches englischsprachiges Werk zur Maschinenethik

- Das deutschsprachige Handbuch Maschinenethik mit einführenden Artikeln verschiedener Autoren erscheint in gedruckter Version im September 2019.

- The Cambridge handbook of artificial intelligence, herausgegeben von Keith Frankish and William M. Ramsey

- Künstliche Intelligenz – Wann übernehmen die Maschinen? von Klaus Mainzer

- Digitaler Humanismus : eine Ethik für das Zeitalter der künstlichen Intelligenz von Julian Nida-Rümelin und Nathalie Weidenfeld

- Eintrag Artificial Intelligence in der Stanford Encyclopedia of Philosophy

- Umfassende Bibliographie zur Ethik der künstlichen Intelligenz auf PhilPapers

Vorschau: In unserem nächsten Beitrag widmen wir uns noch einmal einem sprachwissenschaftlichen Themenkomplex: der Computerlinguistik und ihrem Verhältnis zur künstlichen Intelligenz!

License: Creative Commons 4.0 BY-NC

License: Creative Commons 4.0 BY-NC

Public Domain

Public Domain Copyright United States public domain, [U.S. Air Force photo by Paul Ridgeway ]

Copyright United States public domain, [U.S. Air Force photo by Paul Ridgeway ]

SBB-PK CC BY-NC-SA 3.0 (erstellt: C. Murawski Verticht auf Namensnennung)

SBB-PK CC BY-NC-SA 3.0 (erstellt: C. Murawski Verticht auf Namensnennung)

Aktuelle Verstösse von KI’s gegen ethische Ideale; wesentliche Instanzen der Informationsethik; Presseberichte zum Einsatz von KI durch staatliche Institutionen: https://sensiblochamaeleon.blogspot.com/2023/05/ai-pros-and-cons-informationsethik.html